[原创] 从亚马逊做芯片谈起

2019-12-09

14:00:06

来源: 半导体行业观察

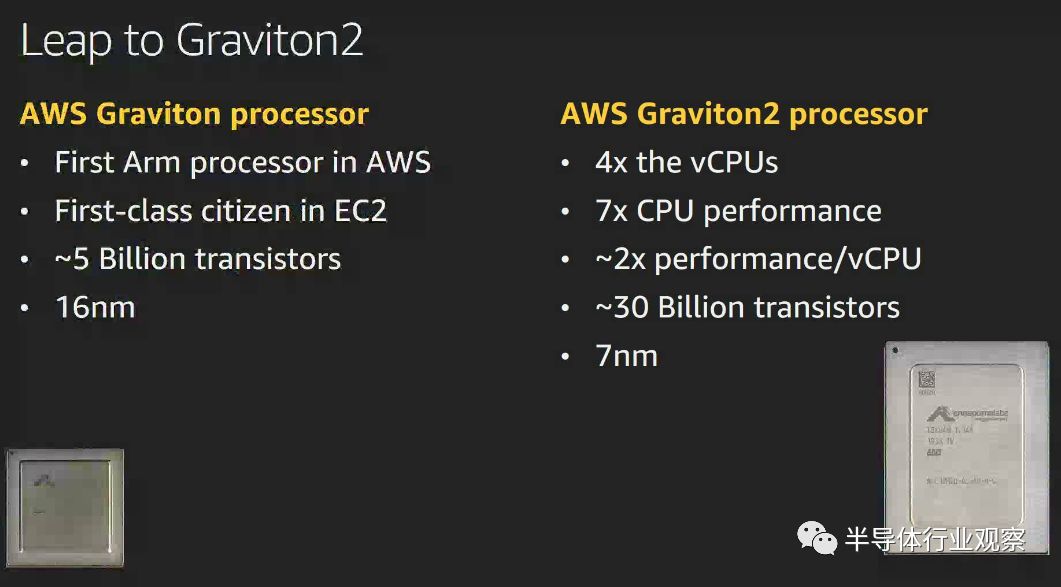

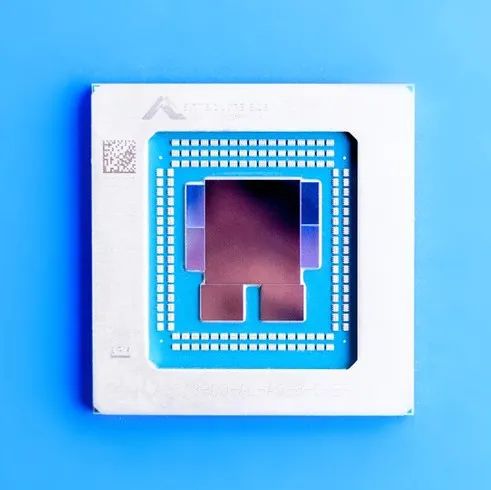

上周,亚马逊的云服务业务AWS在其发布会AWS re:Invent上发布了两款新的云端服务器芯片,分别是高性能处理器芯片Graviton2和高性能机器学习加速芯片Inferentia。我们认为,亚马逊发布的这两款芯片对于云服务市场和半导体行业都有深远影响。

Graviton2和Inferentia芯片

亚马逊的

Graviton2

处理器是亚马逊研发的第二代高性能云端处理器芯片。

Graviton2

基于

ARM

的高端

Neoverse

核,使用

7nm

半导体工艺制造,晶体管数量高达

300

亿,相比上一代芯片核心数增加了

4

倍,且处理器性能也大大提升。

Graviton2

处理器为云计算相关应用做了不少优化,首先是浮点运算能力较上一代有不少提升,此外在指令集上计入了对于机器学习推理应用的支持,以及在芯片上集成了亚马逊自研的数据编解码加速器。

相比于基于

x86

处理器的解决方案,

Graviton2

处理器可以大大提升性能并降低成本,性能/成本比提升可达

40%

。

在软件上,

Grativon2

处理器能兼容主流的开源

Unix

操作系统和

Docker

容器,这也从很大程度上解决了

ARM

服务器端处理器生态的问题。

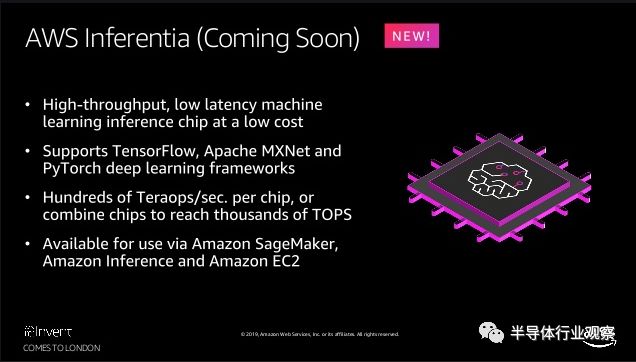

除了高性能处理器之外,亚马逊发布的另一款芯片是Inferentia,用于加速机器学习推理计算。

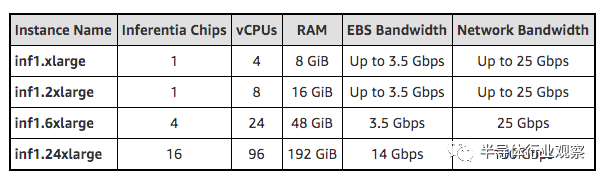

根据亚马逊公布的指标,Inferentia芯片能提供128TOPS的算力,并支持INT-8和FP-16/bfloat-16计算类型。亚马逊同时公布了几种搭载了Inferentia芯片的服务器配置,最高性能的版本搭载了16颗Inferentia芯片,从而能提供高达2000TOPS的峰值算力。

亚马逊自研芯片对云服务的影响

亚马逊今年发布最新的自研云端服务器芯片意味着云服务市场的格局在大数据-人工智能时代相比之前有了深远的改变,而这个改变最关键的部分就是算力成为了越来越重要的性能指标。

上一代云计算主要承载的业务是让有IT需求的公司把IT系统在云端执行,这样就省去了本地的维护成本。举例来说,一家公司需要架设一个内部的ERP系统,在没有云服务的时候需要自己去购买服务器,还需要组建一支专业的IT团队来负责服务器硬件的维护,这样就让IT服务的成本变得比较高。而有了云服务之后,这类系统可以直接在云服务商的数据中心完成,公司无需再去购买服务器也不用担心服务器的稳定/维护/升级问题,这样就大大降低了成本。公司需要做的无非就是确保选择正确的云服务商,并保证有稳定的网络连接。由此可见,上一代云服务主打的卖点往往是服务器带宽,云服务稳定性,云服务系统部署简易性等等,总而言之更偏向于服务质量,但是与硬件关系不大。

随着云计算进入大数据和人工智能时代,云计算的需求也与时俱进。目前,云计算的概念已经深入人心,因此大量公司的网络业务都已经上云,而随着人工智能和大数据业务逐渐变为主流,云计算对于大数据和人工智能的支持也需要跟上。而这一代基于深度学习的人工智能浪潮对于算力的需求尤其大,算力正在成为新的基础设施,因此,我们认为云服务的核心竞争力正在慢慢转向算力。

由于算力正在成为云计算的核心竞争力,因此硬件对于云计算来说也变得越来越重要。在上一代云计算中,对于硬件的需求非常单纯,只需要普通的服务器级别x86处理器搭配足够大的内存和SSD即可,而随着对于算力的需求提升,对于硬件的需求也在快速提升,且呈现专门化。如果总结亚马逊云计算中算力相关硬件芯片的迭代,我们可以清楚地看到一条由通用走向专用且性能快速提升的道路。最早的云计算使用传统的CPU,随着人工智能变得火热,带有GPU的云服务器进入了主流视野。相比面向通用计算的CPU,GPU主要支持人工智能训练和推理计算,通用性下降了一些但是算力提升了数百倍。在之后,亚马逊发现GPU的性能还不够好,尤其是在大量的人工智能推理任务上,因此这次发布了Inferentia ASIC用于高性能低成本推理计算。

放眼未来,我们认为云计算越来越强调算力的势头还将继续,我们渴望看到更多的云计算服务商加入提升算力的行列,同时也将看到硬件和芯片将在云计算领域的地位越来越重要,成为算力的核心支柱。

亚马逊自研云端芯片对于半导体行业的影响

亚马逊大力投资自研云端服务器芯片意味着云端服务器芯片的市场格局发生变化,通用的CPU和GPU无法覆盖整个市场需求。

从技术层面上来说,随着深度学习神经网络模型对于算力的需求快速提升,这意味着将催生高性能计算芯片市场较快发展。业界和学界对于高性能计算芯片的探究在数十年内从未停下,但是在人工智能时代到来之前,由于高性能计算的市场始终有限,因此相关技术的资本投入较小,主要是实验性质的探索,新技术产品化落地的比例并不大。但是随着高性能计算在人工智能时代成为主旋律,对于新一代高性能计算技术的需求呼之欲出,因此我们预期会看到更多技术上的突破被真正产品化。

我们认为,有以下的几个技术有很大的潜力:

(1)chiplet技术。

在高性能计算领域,芯片为了追求性能会集成越来越多的晶体管,同时会需要使用最先进的半导体工艺制造。然而,“集成越来越多的晶体管”和“使用最新半导体工艺”这两件事在摩尔定律遇到瓶颈的今天存在一定矛盾,因为在最新半导体工艺下的大芯片良率会下降,成本也会大大提升。因此,一个解决方案就是chiplet,把一块大芯片拆成多个小的chiplet并使用高级封装技术做集成互联,从而实现性能和成本间的折衷。

(2)众核技术。

在大数据人工智能时代,对于算力要求很高的计算往往是可以并行化的,因此可望通过众核技术来解决并行计算的问题。下一代众核技术需要能相比GPU的SIMT拥有更强的数据流支持,并提供更好的众核间数据通信方案,从而提供更好的性能。

(3)可重构和异构计算技术。

可重构和异构技术其实是一个硬币的两面,分别代表了通用性和专用性。使用可重构计算能实现较好的通用性,但是代价是性能上会有一定损失;异构计算则强调极端性能,但是一旦任务改变,则会让芯片闲置,从而带来dark silicon问题。如何在可重构和异构计算之间找到一个这种平衡点将是未来的一个重要技术课题。

从市场层面上来说,由于通用的CPU和GPU已经难以满足用户对于算力的需求,因此我们可望看到更多云服务商会采用非常规的芯片。这另一方面也涉及到了竞争差异化的问题,随着算力成为最主要的竞争指标,如果使用所有竞争对手都能买到的CPU/GPU,那么就没法实现差异化竞争了。因此,从用户需求和竞争两个角度来看,都会有越来越多从事云服务的互联网巨头加入自研芯片的行列。自研芯片包括几种形式,包括与Intel这样的传统处理器芯片商合作以开发带有一定定制化功能的处理器芯片,或者去购买IP来搭建自己定义的SoC,以及全定制的功能模块。一般来说,处理器核心的门槛很高,通常采用IP授权的形式,但是专用应用加速器的设计则较简单,可以采用全定制的方案。因此,我们预计会看到越来越多的自研芯片案例,同时ARM的服务器端处理器IP授权业务将得到较大的发展,有望成为移动端处理器核心之外的另一个重要业务;但是人工智能加速器这类的IP我们认为更有可能是云服务商去做全定制。

*免责声明:本文由作者原创。文章内容系作者个人观点,半导体行业观察转载仅为了传达一种不同的观点,不代表半导体行业观察对该观点赞同或支持,如果有任何异议,欢迎联系半导体行业观察。

今天是《半导体行业观察》为您分享的第2153期内容,欢迎关注。

『

半导体第一垂直媒体

』

实时 专业 原创 深度

识别二维码

,回复下方关键词,阅读更多

日本半导体|AI

|台积电

|IC

|

亚马逊

|

RISC-V|高通|DRAM

回复

投稿

,看《如何成为“半导体行业观察”的一员 》

回复

搜索

,还能轻松找到其他你感兴趣的文章!

责任编辑:Sophie